Eventos culturais e emocionais que fui nesta semana linda…

Read More

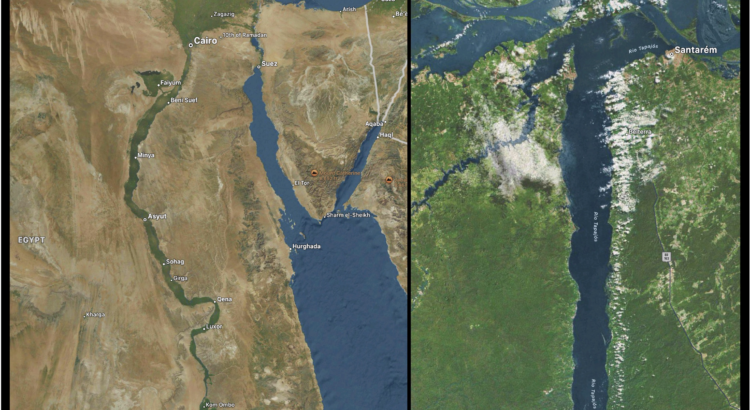

Nilo × Amazonas

Tati acabou de voltar do Egito 🇪🇬 e conta as maravilhas do Rio Nilo, como é majestoso, surpreendentemente limpo — mesmo com o caos do Cairo nas suas margens —, e como é caudaloso e um pouco mais largo que o Rio Tietê na cidade de São Paulo (rio abaixo, perto de Santa Maria da Serra, o Tietê é bem mais largo).

Lembro que anos atrás discutia-se qual rio era o maior do mundo, o Nilo ou o Rio Amazonas. Essa conversa mole acabou da noite pro dia quando alguém lembrou que ficar medindo comprimento de rio era pura bobagem porque o Amazonas é algumas centenas de vezes mais largo que o Nilo e transporta não sei quantos zilhões de litros a mais de água.

Só o Rio Tapajós, um dos afluentes do Amazonas, tem 14km de largura (quatorze quilômetros de largura) em seus últimos 220km antes de desaguar no, ainda maior, Rio Amazonas. É uma piscina oceânica de 14×220≈︎3000km²︎ de superfície, só um trecho, só do Tapajós.

Não tem prá ninguém contra os rios do Brasil. Sensacionais esses rios do nosso planeta, sobretudo os brasileiros.

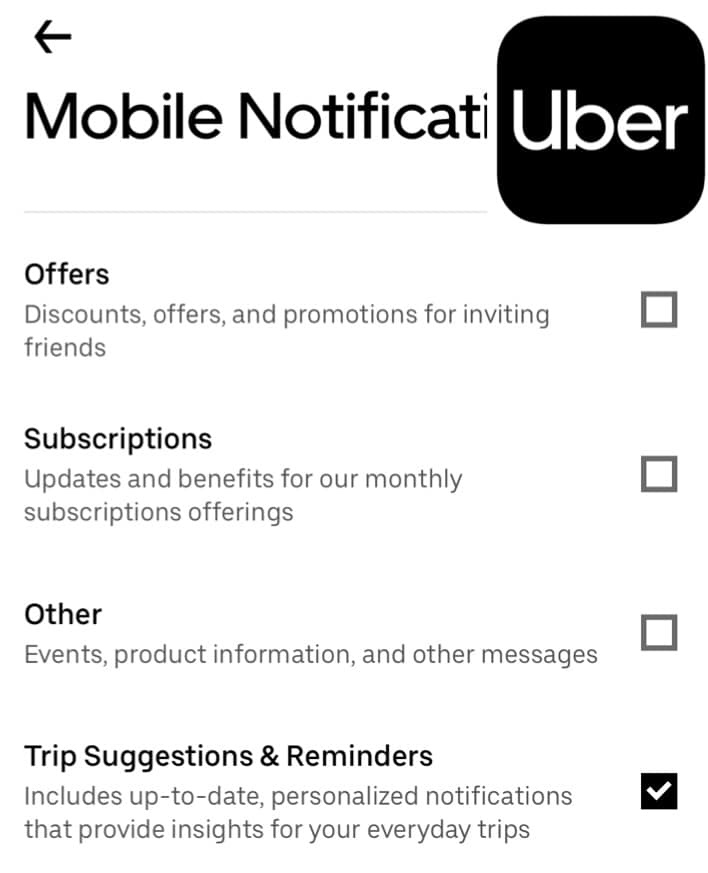

Filtre propagandas do Uber

Na app do Uber, vá em 👤Conta ➔ ⚙️Ajustes ➔ 🟡Privacidade ➔ 🔴Notificações e deixe só o último ligado.

Assim você pára de receber as propagandas irritantes deles, só recebe as notificações de suas corridas.

Repare que a função mais importante para o usuário é a última da lista. E as 3 primeiras são só as bobagens dispensáveis deles. Depois é “usuário em primeiro lugar”. Sei.

Isso não é sorvete

No supermercado todas as opções de sorvete são “oleína de palma”, “gordura vegetal” e “pó saborizante sabor iogurte”, até nas marcas premium que demonstram forte associação com leite. A única excessão é 1 marca, importada, de nome que remete aos Alpes, com preço 11 (onze) vezes superior. Eu sai sem levar nada.

Esse abismo de opções intermediárias não é escassez de bons ingredientes. É falta de regulação sobre o que é “sorvete”. E sem regulação, fabricantes fazem escolhas estratégicas e uso intenso de método e ciência — tecnologia de alimentos, análise de dados, marketing e merchandising — novamente, não para melhorar produtos, mas para aumentar lucro dos fabricantes.

Eu não tenho nada contra lucro. Mas a que custo?

Algumas palavras na lista de ingredientes não são conhecidas pelo meu corretor ortográfico. Vai ver que é aí que reside a inovação desses produtores: inovam em formas de enganar o consumidor.

Luminária que é uma belezura

Uma belezura de luminária que eu quase comprei prá minha filha ler. Sem fio, luz regulável, recarrega por USB, baixo consumo, tem até alto-falante bluetooth embutido. R$120.

— Que show, moço. E comé que troca a lâmpada?

— Não troca. É prá descarte quando queima.

— Ela toda?

— Tudo, com bateria, 400g de plástico, alto-falante, lâmpada queimada e tudo.

E assim devolveremos aos nossos filhos um planeta com uma pilha de lixo descartável e tóxico prá eles viverem.

Como é que deixamos isso acontecer?

Ele não tinha nenhuma outra opção para iluminação de cabeceira. Loja de iluminação.

Eu não comprei.

Má política e patrocino comercial

A marca Puma patrocina o jogador Neymar. Mas Neymar declarou apoio a um político condenado por crimes contra a humanidade (link nos comentários), conhecido pelo seu sadismo e elogios à tortura e que, nem veladamente, apoia, por exemplo, desmatamento ilegal.

Como fica a situação da Puma que é a 2ª empresa têxtil mais sustentável do mundo?

Artigo intrigante de Rodrigo Tavares na Folha de São Paulo.

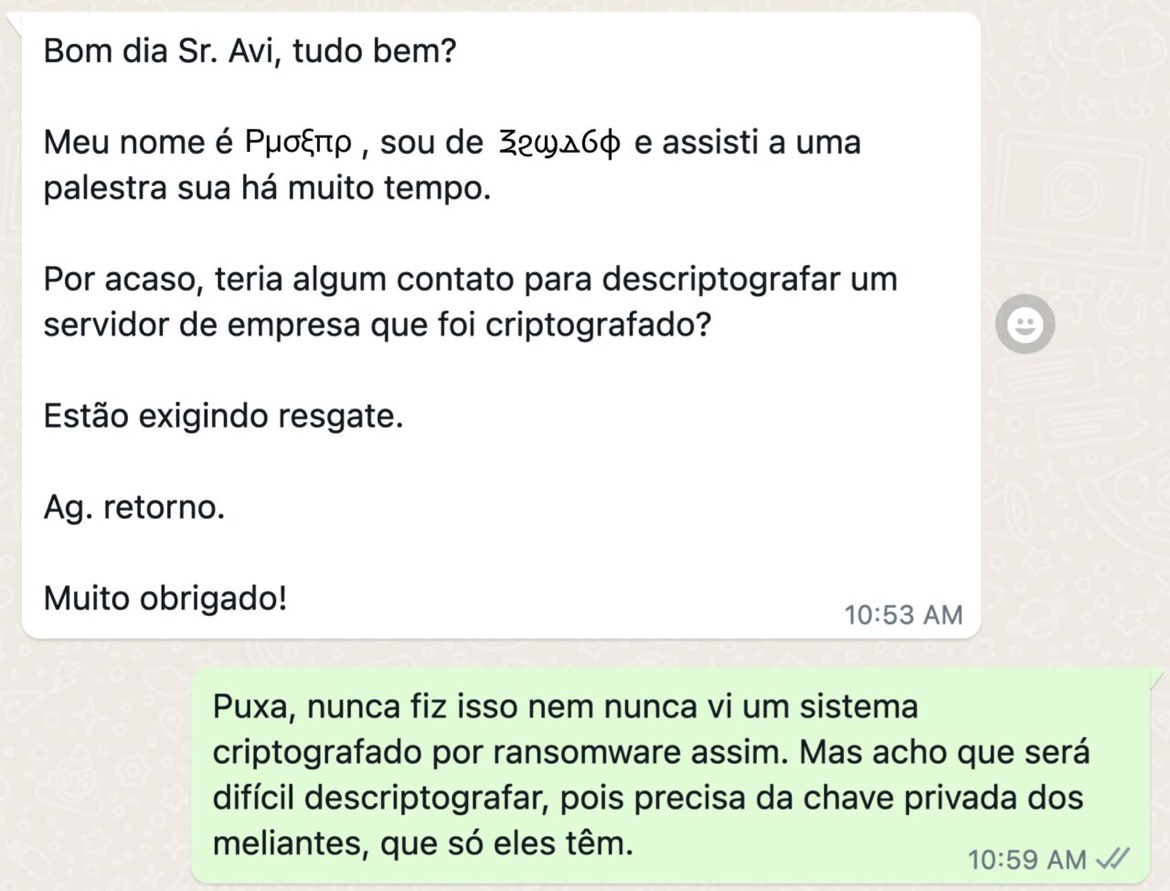

Sequestro digital

Isso é desesperador

Biometria facial nos aeroportos

Por que o Serpro e os Aeroportos do Brasil adotaram biometria facial ao invés de leitor de dedo?

Porque o leitor de dedo, como sabemos, é anti-higiênico, dissemina doenças e fluidos indesejados. E porque o seu rosto é a informação mais pública que você possui. É como se houvesse alguém com memória facial infinita reconhecendo pessoas na fila, só de olhar para elas.

Além do mais:

[…] os viajantes poderão optar entre o sistema [biométrico] e os procedimentos tradicionais de check-in e embarque, que continuam disponíveis.

Não sei vocês, mas eu jamais registro ou uso meus dedos em catraca de prédio comercial. Da perspectiva de segurança da informação aquilo é um engodo, além de ser bem nojento. A única excessão que faço é em governos e para documentos, por ser situação não-banal e que se faz uma única vez.

Upgrade to USB-C

22 years into 21st century but new products still feature connectors from previous century. Precisely 1996, when this very old USB connector was released.

Product designers, please upgrade to USB-C, which is already 8 years old. It’s about time!

5G Download Speed

5G download speed at home in São Paulo today. 420 megabits per second (mbps), equivalent to 52 megabytes per second.

It means that it takes about 10 seconds to download 1 hour of hi-fi music without any compression. But since compression is everywhere, just 2 seconds will be enough.

Upload speed gives me 10 mbps. Pretty good, though we know this is probably not for long.

What 4G, 5G speeds do you get and where?

State of the Windows Laptop Market

The Windows-based laptop market is a bad joke of confusing, overlapping offerings. It operates almost like a scam to underskilled consumers because manufacturers try hard to increase their profit around a purely commodity product. The results are “creative” but quite useless features as detachable keyboards, pens and tablet PCs. If you have one of those, think about the rare situations you actually used them in a comfortable way.

For a general use laptop, a $1000 MacBook Air has all the features you need, in order of importance: great high density screen (a.k.a. Retina display, most important feature, always), light and small and elegant, fast internal storage, outstanding global customer service, enough RAM (8GB minimum, 16GB recommended), modern connectivity with USB-C. Oh, and a good CPU too.

Don’t go for less than that and be aware that a similar feature set in the Windows universe will have same price, if not more. But it will be hidden under a pile of confusing, overlapping and oversized configurations.

This post was written for your private life laptop consumer self, to help you buy your next good laptop. Not for your corporate self.

“Free Market” is a myth

Insightful tweet by Robert Reich, Public Policy professor at UC Berkeley and Harvard:

The naturally occurring “free market” is a myth. The market is a set of rules organized and maintained by governments.

The real question isn’t free market or government — it’s whether the current rules favor the many or the few.

Um sonho de verdadeiro poder

Sonhei que minha consciência de 48 anos de idade foi passar um tempo no meu corpo e na minha vida de 13 anos de idade.

Eu era plenamente consciente desse fenômeno incrível e achei uma linda oportunidade de assistir e observar minha vida de pré-adolescente, minha relação com minha mãe, meu pai e minha irmã. Eles ainda não tinham chegado em casa, só estava lá o Djavan e eu tinha hora marcada na ginástica, essas coisas malucas de sonho. Fui pro meu quarto, vi meu velho computador (que nem lembro se já tinha naquela época) e senti o frenesi de reusá-lo prá achá-lo frugal. Peguei um short para vestir, vi algumas das minhas roupas de adulto no meu armário de 1986 e pensei “puxa, as tenho desde então?!”. Eu estava ansioso por aquela experiência transcendental, mas aí o sonho acabou logo quando sai prá ginástica.

Quando acordei contei o sonho prá Tati e fiquei pensando na dualidade entre nossa vida material e espiritual. Onde temos sabedoria superior na vida espiritual, mas encarnamos na vidinha da Terra. No meu sonho, a minha consciência superior conferia serenidade, leveza, poder e sensação de oportunidade para a minha vida juvenil na Terra.

É esse sentimento que quero para a minha vida.

O arrasto sem fim das séries de TV

Então serão 28 horas da minha vida que eu não vou sair prá conhecer lugares novos, nem ler, nem assistir documentários, nem assistir 14 filmes diferentes de conteúdo mais edificante, nem ouvir música, nem ir a shows, nem tirar sonecas. Serão 28 horas sequestradas do meu ócio, longe dos meus hobbies para assistir os 36 episódios em 4 temporadas dessa série (Stranger Things) com a minha filha.

E pior é que sei que vou gostar pois é feito pelos melhores profissionais do mundo, que usam todas as artimanhas para arrastar o episódio quase todo de forma insossa até atingir o clímax bem na hora que ele vai acabar, prá fazer você querer assistir o próximo episódio. A troco de que?

O que a gente não faz por esses filhos…

Java is the New Cobol

Java 18 was recently released and I can’t help reminding you that Java is the new Cobol: everybody heard about it, even have some legacy in production, needs to be supported, is important, but please don’t ask me to start any new project with Java, because there are much better things I can use today.

Novas fronteiras do Balé Clássico

Ontem foi belíssimo e aprendi várias coisas sobre as novas fronteiras do balé clássico, de modo que eu queria registrar essa memória aqui.

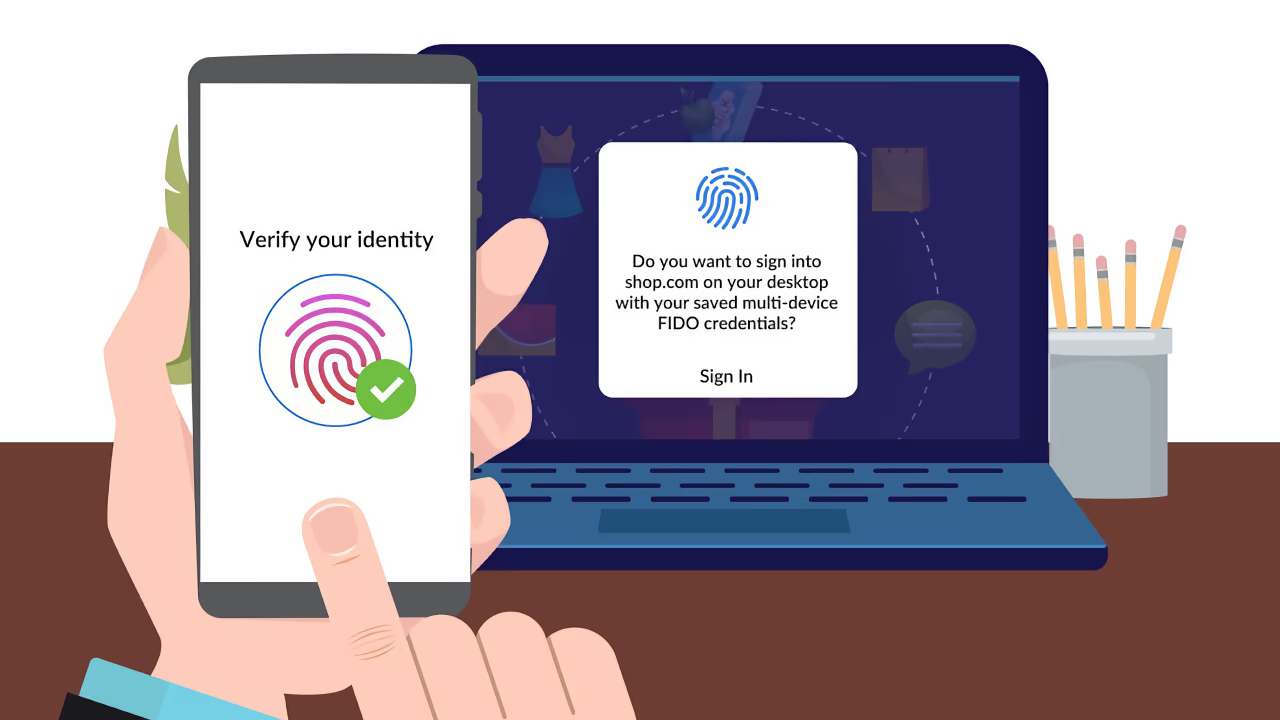

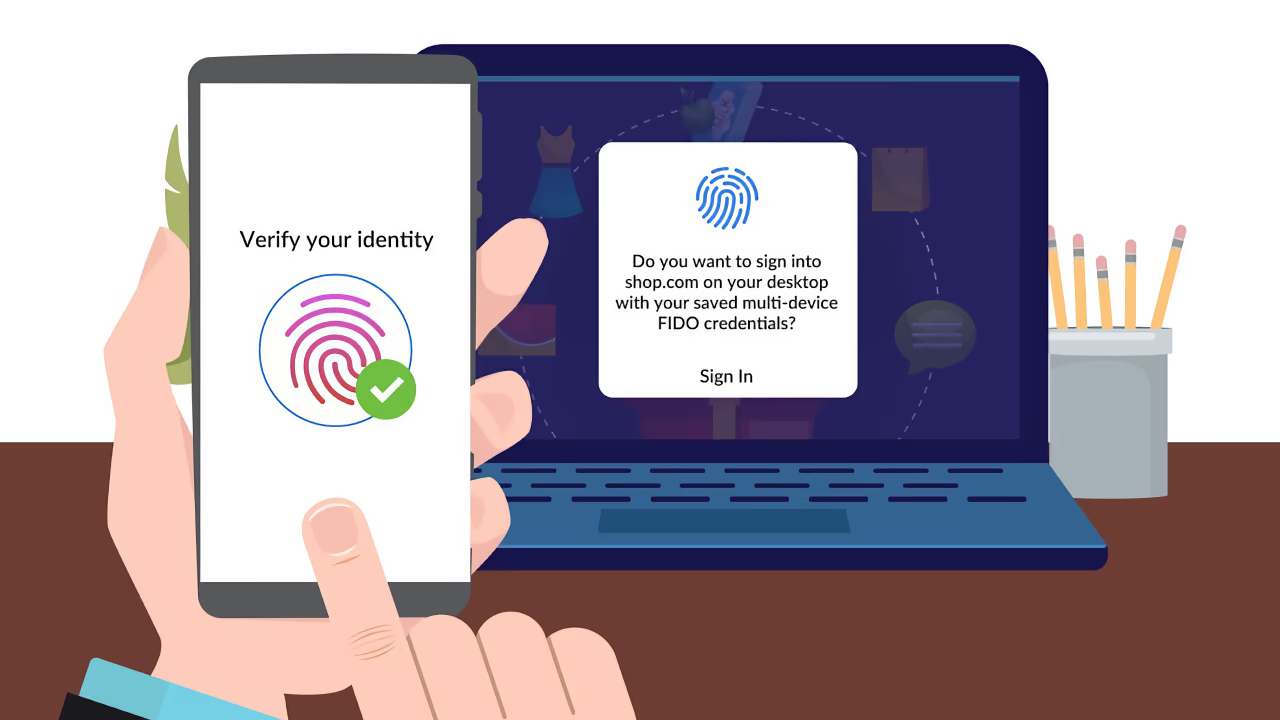

Passwordless Sign-in

Get ready to say goodbye to password managers or even all your passwords. Thanks to FIDO, the industry is shifting to open standards password-less authentication everywhere.

Who’s been using macOS, iOS credential management, integration and synchronization already have an idea about how it works across devices, apps and websites. But now the experience will be improved, extended and made even easier.

Power solution to rule them all

The one single power and connectivity kit needed in your laptop backpack.

① One +65W USB-C power charger

② One USB-C 2m/6ft cable with Power Delivery

③ One USB-C kit of adapters to old USB and Micro USB

④ One USB-C adapter to Apple Lightning

This kit: Powers your modern laptop through USB-C. Charges your phone through Lightning or USB-C. Charges eventual other devices on their old USB ports. Connects all devices to one another.

Portable batteries are obsolete. Instead, use your large and powerful laptop battery to charge your phone on the road.

Caution with Streamlit

Streamlit (streamlit.io) is a lovely Python module that helps data scientists build interactive dataviz apps.

Use it when a BI is overkill — as this Streamlit dashboard that I wrote to manage my personal investments —, or where there is no BI, such as very small companies. Or where there is no interactive app developers to create a native app.

Read MoreImpressions about Open Data Science Conference Boston 2022

Open Data Science Conference 2022 has happened in Boston this week. Conference featured panels, workshops, presentations and a vendor expo. I attended the 3 days and here are some impressions.

Perfumes de Padaria

Clara e eu fomos ao shopping de Cambridge bater perna. Seu olfato jovem é fã de lojas como Victoria’s Secret e outros “perfumistas”.

Read More

“Carnes” impossíveis

“NOVO SABOR MAIS CARNUDO” — é o que vem escrito na embalagem dessas “carnes” vegetais.

Read MoreOs melhores sorvetes que tomei (até hoje)

Os sabores de sorvete que mais me marcaram são:

- Bacuri, da sorveteria Cairú no Pará

- De Milho Natural (natural, na-tu-ral, sem essências) do Rei da Pamonha, nas estradas paulistas

- Fantasia de Laranja da Sotto Zero, quando eles eram bons

- Coco

espumante na Bahia, que não é bem sorvete, mas funciona igual. Água de coco gelada batida com carne de coco verde congelada. Só, sem açúcar nem nada. Fiquei chocado como demorei décadas para descobrir essa simples iguaria.

espumante na Bahia, que não é bem sorvete, mas funciona igual. Água de coco gelada batida com carne de coco verde congelada. Só, sem açúcar nem nada. Fiquei chocado como demorei décadas para descobrir essa simples iguaria.

Prefer Safari over Chrome

I can’t stand the Mac users that use Google Chrome while they already have the Safari browser.

Safari is lighter, more concerned about privacy, more well integrated to the platform and their other devices (iPhone etc), and is smarter in password management.

I don’t even have Google Chrome installed on my Mac.

Use Safari on your Mac

I can’t stand the Mac users that use Google Chrome while they already have the Safari browser, which is lighter, more concerned about privacy, more well integrated to the platform and their other devices (iPhone etc), and is smarter in password management. I don’t even have Google Chrome installed on my Mac.

Chatice ufanista do LinkedIn

A chatice do LinkedIn vem do fato de que as pessoas o usam, majoritariamente, para divulgar grandes conquistas e outros egocentrismos, como se suas empresas fossem perfeitas, quando sabemos que elas operam só para ganhar o máximo de dinheiro que conseguirem, a qualquer custo.

Parece-me que as pessoas são levadas à rede por inveja — “deixa ver o que meu colega fez que eu não fiz” — “deixa eu também mostrar as minhas conquistas maiores ainda”.

A rede seria muito mais útil e interessante se usassem-na para divulgar Ciência (no sentido amplo da palavra) e Conhecimento.

Tudo isso, claro, é só a minha opinião.

Correlação é diferente de Causalidade!

Apesar da RELAÇÃO entre a posição do gato e o telhado amassado, o bom senso sabe que o gato não CAUSOU o amasso. O bom senso aqui vem do conhecimento que todos temos sobre o peso de gatos e a dureza de metais.

Bom senso é fruto de dados analisados, conhecimento, sabedoria, luxos que nem sempre estão disponíveis. Não para qualquer assunto, menos disponíveis ainda para assuntos longínquos, complexos e novos.

Fake news e “narrativas” mirabolantes exploram astutamente essa falta de dados e conhecimento das pessoas com o objetivo de fabricar uma causalidade na cabeça delas — “isto acontece por causa daquilo” — quando na verdade mal existe uma relação.

Agora imagine que você acabou de chegar no planeta, não conhece peso de gatos e tem a impressão que esses telhados são feitos de papel, pois aparentemente amassam como papel. Imagine que alguém adiciona um “malditos gatos” à imagem e que você recebe isso repetidas vezes, de formas diferentes. É bem provável que você comece a odiar os gatos “POR CAUSA do mal que fazem”. É assim que funciona nosso viés — começa com falta de informação — e é esta a fraqueza humana explorada por notícias falsas e memes em geral.

Cientistas de dados, estatísticos, economistas e pessoas que estudam fenômenos naturais e sociais, sempre, SEMPRE, precisam se lembrar que correlação observada não implica em causalidade para não cairem na armadilha do viés, que leva a conclusões erradas.

A foto do gato apareceu neste tweet: https://twitter.com/packetlevel/status/1451584653748408323

Mais correlações espúrias aqui:

https://tylervigen.com/spurious-correlations

Canção Um Índio, de Caetano

Esta canção voltou à minha cabeça creio que por causa das coisas que ando lendo sobre mudança climática, decadência social de grande quantidade de pessoas etc.

Fala de uma Terra depredada pela civilização e aí vem um índio-messias que deixa todos atonitos por falar e fazer nada mais do que o óbvio.

Uma pessoa — Caetano Veloso — que escreve uma letra profética como esta, já em 1976, 45 anos atrás, merece todo o meu respeito.

Um índio descerá de uma estrela colorida e brilhante

De uma estrela que virá numa velocidade estonteante

E pousará no coração do hemisfério sul

Na América, num claro instante

Depois de exterminada a última nação indígena

E o espírito dos pássaros das fontes de água límpida

Mais avançado que a mais avançada

Das mais avançadas das tecnologias

Virá, impávido que nem Muhammed Ali, virá que eu vi

Apaixonadamente como Peri, virá que eu vi

Tranquilo e infalível como Bruce Lee, virá que eu vi

O axé do afoxé, filhos de Ghandi, virá

Um índio preservado em pleno corpo físico

Em todo sólido, todo gás e todo líquido

Em átomos, palavras, alma, cor, em gesto, em cheiro

Em sombra, em luz, em som magnífico

Num ponto equidistante entre o Atlântico e o Pacífico

Do objeto, sim, resplandecente descerá o índio

E as coisas que eu sei que ele dirá, fará, não sei dizer

Assim, de um modo explícito

Virá, impávido que nem Muhammed Ali, virá que eu vi

Apaixonadamente como Peri, virá que eu vi

Tranquilo e infalível como Bruce Lee, virá que eu vi

O axé do afoxé, filhos de Ghandi, virá

E aquilo que nesse momento se revelará aos povos

Surpreenderá a todos, não por ser exótico

Mas pelo fato de poder ter sempre estado oculto

Quando terá sido o óbvio

Aos que foram nas manifestações golpistas de 7 de Setembro

Eu conheço gente que foi na manifestação golpista do 7 de Setembro. Gente que foi lá combater “o sistema”, convocados pelo próprio sistema. Sendo que quem chamou — o presidente fraco e demente — usa o sistema em sí (Medidas Provisórias, PGR, Congresso, foro privilegiado, dinheiro público etc) prá proteger pessoalmente ele próprio e sua própria família.

É um amontoado de contradições e incongruências distópicas que essas pessoas não entendem e isso as faz passarem uma vergonha inacreditável.

Sinto um misto de pena e vergonha alheia dessas pessoas.

Cuide de suas finanças

Quando sai da CI&T (grande empresa) uns meses atrás, mandei um e-mail de despedida pros colegas que tinha este trecho:

Prá fechar, eu queria deixar aqui um conselho bem anti-trabalho. Sobre dinheiro, gaste seu tempo de maior valor (depois de família, viagens, amores etc) cuidando de seus investimentos financeiros. Aprenda a operar na bolsa de valores, aprenda sobre taxas de juros, rentabilidade, arriscar um pouco com criptoativos, montar um portfolio rentável com risco balanceado. Não terceirize isso para os bancos de investimentos. No longo prazo, são essas coisas — e não exatamente trabalho eterno — que vão garantir uma aposentadoria tranquila para você. Quanto antes começar, melhor.

Conta de padeiro: se você cuidar direitinho de seus investimentos, se fizer rendimento médio de 7%, 10% ao ano, em 10 ou 12 anos você dobra o seu capital. Se começar cedo, antes dos filhos nascerem, até chegarem a idade adulta você quadruplica seu capital. Se deixar os bancos de investimento cuidarem de suas finanças, você renderá só uns 3% ao ano.

Pense nisso.

Good luck to Kyndryl

To all friends that I’ve worked with at IBM and that are now moving to Kyndryl, I wish you success and good luck. The Cloud and IT services opportunity will continue to be huge forever. The countdown you have promoted here was warm and vibrant.

For the still-on-IBM friends, please keep on doing such a great company that always was and continues to be a brilliant reference to the world, not just IT. IBM is an unforgettable school for me and for anybody else that has spent even just a minute working there.

Business worldwide, as we know it, is shaped by companies such as IBM, even if you’ve never heard about it (well, that’s quite impossible).

Meus Alunos de Dados

Que satisfação ver meus alunos da Digital House ingressando em novas empresas, em cargos de dados.

Como eu vivo dizendo a eles, Dados é uma oportunidade continental, equivalente a descoberta do Novo Mundo em 1492. E é também como sexo de adolescente: todo mundo diz que está fazendo, mas na verdade ninguém, praticamente ninguém mesmo, está fazendo direito.

E é essa geração de profissionais de dados que farão acontecer.

Mãos à obra!

Zona de Conforto ou Empreender?

Numa discussão ali argumentavam que a pessoa precisa ganhar dinheiro o suficiente para passar a ser um empreendedor, para sair da zona de conforto, para sempre evoluir.

Não posso concordar menos com isso. Qual é o problema com a zona de conforto? É o ministro da economia que quer que tudo sempre evolua, não o indivíduo. Por que não seria válido a pessoa ganhar dinheiro suficiente para levar uma vida confortável sendo meramente empregada numa empresa?

Empreender envolve muita responsabilidade e dedicação. Isso certamente te remunera no médio prazo, se você também tiver sorte. Mas é incrivelmente estressante, tira sua tranquilidade e não deve ser a única forma de ter uma boa vida numa sociedade avançada da nossa era.

As pessoas querem viver em paz, viajar com os filhos, estender os finais de semana, ter dias de folga, consumir cultura, cuidar da saúde, dormir bem. Empreendedor estressado e que “sempre busca evoluir” tende a não ter nada disso nos anos bons de sua vida.

Também no LinkedIn.

Como Escolher e Comprar um Laptop

Um laptop funcional, poderoso e elegante para a maioria das pessoas custa em torno de $1000. Um MacBook da Apple nessa faixa de preços deve atender bem 95% das pessoas: navegar na Internet, editar documentos, editar fotos/videos/multimídia simples, assistir a filmes/videos, jogos comuns e ter bateria de longa duração. Mas se você quer ir de Windows, prepare-se para atravessar a nado um oceano de ofertas confusas que fabricantes despejam no mercado em seu esforço para se diferenciarem para conquistar clientes, com características que o consumidor poderia dispensar.

Read MoreHow programmers should record time

We the data people immediately identify a poorly designed system when we see it handling date and time as plain local time, instead of the number of seconds since January 1st 1970 of time zone 0.

- This post was published on 1,626,425,523 (UTC, always UTC).

- Jesus was born -62,399,513,432.

- Man visited the moon between -14,552,880 and 93,172,200.

- And so on…

Just your daily dose of nerdy facts…

Die, e-mail, die, die

Nobody here reads e-mails. Avoid sending e-mails. If you need to send an e-mail to someone, notify him/her on Slack in order to actually have them reading it.

First week on a startup.

Die, e-mail, die, die. Finally!

What means to be Driven By Data

I’ve seen companies saying they have Big Data because they implemented Hadoop or a data lake and maybe Spark.

That’s just wrong.

Big Data, or more precisely, to be Data Driven, is a state where the data a company produces can be reused, as soon as possible, to optimize itself. And there are many ways to reuse data: all meetings and decisions happen with abundance of data, or recently generated data instantly feeds machine learning algorithms to optimize transactions, just to name a few situations.

To be Driven by Data is part culture and part infrastructure. On the infrastructure side, IT teams still struggle with limited visions about how data should flow pervasively and how access should be granted. They fear about security and performance while they should fear of missing out the data opportunity.

Data Streaming is a breakthrough recent technology that is here to help with more fluent data access. For an agile and effective data architecture, Data Streaming is much more strategic and important than just a bigger data warehouse because it is the component that can unleash your data and finally make it useful.

Cartão de Crédito e Educação Financeira

Cartão de Crédito nada mais é do que empréstimo de dinheiro pré-aprovado a juros altíssimos, disponível na hora que se deseja/precisa usar.

Sua fatura mensal é uma comodidade banal para quem tem dinheiro, mas é a corda no pescoço para o pobre no caixa do supermercado com a compra de comida para a família. Na farmácia e na loja de indulgências também. Uma corda que sempre aperta mais e ele não vê perspectiva de soltar. Mesmo que num mês irreal ele não gaste nada, os juros farão trazer uma fatura sempre mais alta.

Read More

Se eu fosse rico

Todo mundo quer ser rico e eu também.

E aí numa conversa descobri que meu ideal sagitariano e estóico de riqueza não é muito comum.

Prá começar, carro de luxo nem pensar. Prá que continuar preocupado com multas, batidas, lugar prá estacionar, depreciação? Quando eu for rico, só vou andar de táxi. Atravessar a cidade prá visitar a irmã? Táxi. Viagenzinha pro interior com a família? Táxi. Prá ver a paisagem, ler, conversar, cochilar.

Refeições eu faria em restaurantes. Todas as 3 refeições do dia. Todos os dias. Nunca mais me preocuparia se tá faltando ovo e brócolis e nem se as coisas na geladeira já vão estragar. Louça suja não existiria para mim. E o melhor: nunca mais teria que pensar 3 vezes ao dia o que preparar para as crianças comerem. Eu quero é ver o cardápio. Mas aí eu seria tão rico que também teria nutricionista prá prestar serviço ao vivo de montar refeição saudável e balanceada em todos os lugares que fossemos comer.

Cobertura? Casa de luxo? Faço nenhuma questão porque ainda teria que me preocupar com decoração que impressione amigos, manutenções sem fim, despensa de comida e material de limpeza, o que acumular e o que jogar fora. Quero não. Eu moraria em hotel mesmo. Cinco estrelas, claro. Tipo suíte do Copacabana Palace ou do Tangará, que já provei e aprovei para morar longas temporadas. Enjoei da decoração, do bairro, da cidade? Fácil, é só pagar a conta e ir a outro hotel. Ou resort. Ou outro lugar com serviço completo, daqueles que você sai para tomar café e volta e já tá tudo arrumado e dobrado.

“Ah, mas alguma hora cê não vai querer voltar prum canto que é só seu?” Não. Entendo que “voltar” presume “ter ido embora”, e creio que nunca fui embora de mim mesmo. A nossa morada somos nós mesmos, né não?!

“Ah, mas onde você vai guardar suas coisas?” Na nuvem e numas 2 malas de roupas, ou menos. O resto das coisas eu abriria mão imediatamente por esse estilo de vida desprendido e sem planejamento.

“Ah, mas aí cê estraga os filhos”. Verdade, eu precisaria pensar melhor nessa parte, mas dá uma preguiça…

Dizem que eu tenho uma concepção de pobre sobre essa riqueza pretérita. Chame do que quiser, eu só não quero compromissos, responsabilidades, ter que fazer compras, contratar manutenções para eletrodomésticos etc. Desprendimento seria o centro. Até a própria riqueza seria um acessório só para viabilizar conforto e mais desprendimento.

Pronto falei, podem jogar as pedras.